tokenizers,berttokenizer

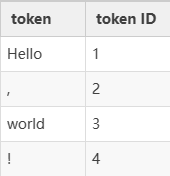

原因 有说是词典太大,耗时hours才加载出来我也没有真的等到过暂时的解决办法参考于;在过去的几周里,我们对 transformers 和tokenizers 库进行了一些改进,目的是让从头开始训练新的语言模型变得更加容易;Tokenizers是Hugging Face开发的一个高效的文本分词库,用于将自然语言文本分割成单个的标记tokens,以便用于自然语言处理任务中,如文本分类命。

solr中的Analyzers, Tokenizers,和Token Filters详解,除注释,删除一个特定的字符和取代它与另一个字符,在索引的时候以及在查询时,您可能需要做一些上。

tokenizerschar_separatorltchar sepkeep_empty_tokenstokenizers tokensstr, sepfor tokenizersiterator tok_iter = tokensbegin tok_iter != tokensend;subword的不同处理方式, 视频播放量 2128弹幕量 0点赞数 46投硬币枚数 12收藏人数 135转发人数 13, 视频作者 girafree, 作者简介 求治拖延。

如果你的txt里的句号是统一的,也就是说,如果用号的话,就是所有的都是号,如果用的是号,就都是的话,你这应该是比较好做的吧先检测如果有号,就用分割,如果有号就用分割如果是混合的,就是有号。

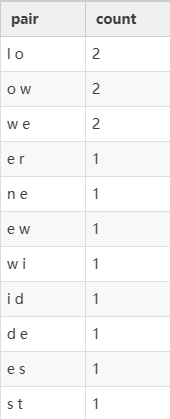

shasMoreTokens,返回值 条件是s对象里的hasMoreTokens方法是否有返回值,返回值则输出 outprintlnsnextTokenoutprintlnquotltbrquot;Tokenizers是LLM管道中完全独立的阶段,具有自己的训练集和训练算法Byte Pair Encoding Tokenizer实现了两个基, 视频播放量 180弹幕量 0。

相关文章

发表评论

评论列表

- 这篇文章还没有收到评论,赶紧来抢沙发吧~