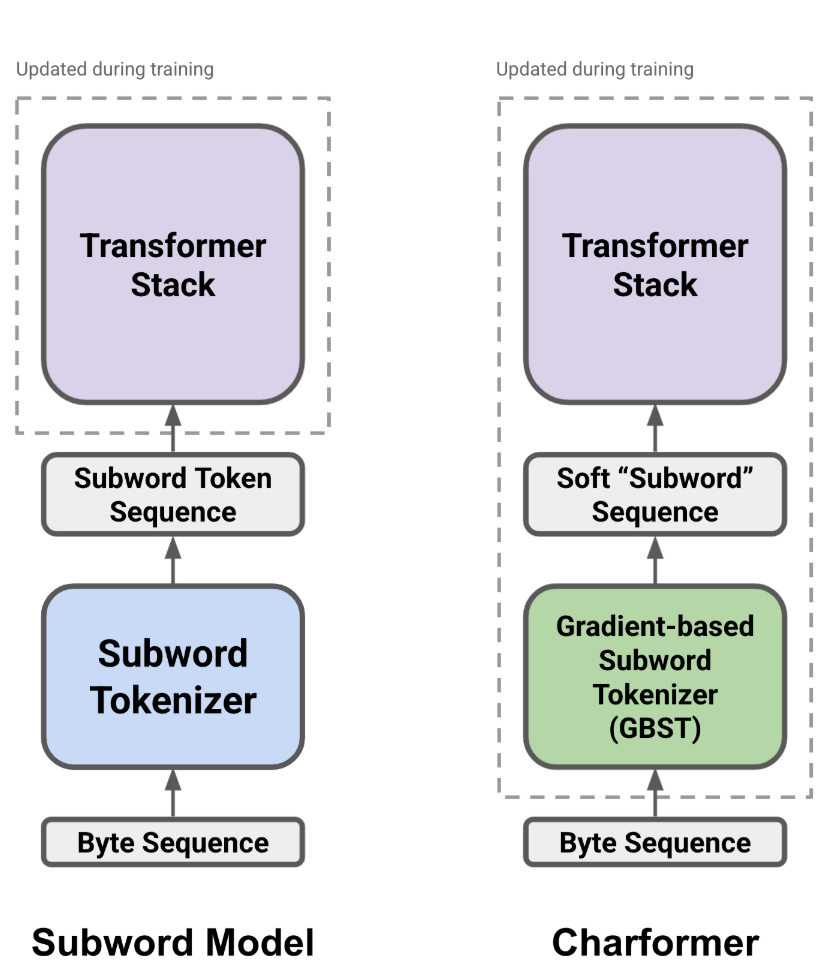

tokenizer分词,tokenizer分词器

在Lucene中,一个标准的分析器Analyzer由两部分组成,一部分是分词器,被称为Tokenizer另一部分是过滤器,被称为TokenFilter一个分析器Analyzer往往由一个分词器和多个过滤器组成这里所说的过滤器,和检索时用的过滤器;如果你指的用指定字符串分割原字符串,可用下面的 split 自定义函数include ltiostream#include ltstring#include ltalgorithm#include ltsstream#include ltvectorusing namespace stdvectorltstring splitconst string。

其中 token 为分词结果 start_offset 为起始偏移 end_offset 为结束偏移 position 为分词位置下面来看下 Simple Analyzer 分词器它只包括了 Lower Case 的 Tokenizer ,它会按照 非字母切分 , 非;5 jieblcut 以及 jiebalcut_for_search 直接返回list 6 jiebaTokenizerdictionary=DEFUALT_DICT 新建自定义分词器,可用于同时使用不同字典,jiebadt为默认分词器,所有全局分词相关函数都是该分词器的映射。

到此为止一个新的类型的分词器就定义好了,接下来就是要如何使用了或者按如下配置curl XPUT localhost9200indexname d #39 quotsettingsquot quotanalysisquot quotanalyzerquot quotikquot quottokenizerquot quotikquot 。

Elasticsearch全文检索默认分词器为standard analyzerstandard analyzer中,character Filter什么也没有做,Token Filters只是把英文大写转化为小写,因此Elasticsearch默认对大小写不敏感,下面主要介绍Tokenizer token分隔符把text;character filtertokenizertoken filters 官网example通常为了保证索引时覆盖度和搜索时准确度,索引分词器采用ik_max_word,搜索分析器采用ik_smart模式 因为倒排索引中的数据是索引时由分词器来处理的,如果分词器有。

如果设置值时差值大于1,需要先设置 indexmax_ngram_diff 参数一文带你彻底搞懂Elasticsearch中的模糊查询 Elasticsearch 警惕使用 wildcard 检索然后呢NGram Tokenizer Elasticsearch Analysis 03 Tokenizer;本节课主要涉及词法分析,将一段话使用分词器tokenizer 进行分词,关键是怎么分词分词的规则是啥一般我们会联想到正则文法进行匹配 如果正则满足不了呢等等一系列的问题在分词过程中我们需要有一个数学模型有限自动。

这些算法称为 Tokenizer分词器 , 这些Token会被进一步处理, 比如转成小写等, 这些处理算法被称为 Token Filter词元处理器 ,被。

它使用一个名为“ngram_tokenizer”的Ngram分词器可以用如下语句测试charSplit分析器,可以看到一字一词的效果curl POST;List不定长,可以暂时用来保存数据全部词元处理完之后可以进行转化List和数组可以很方便的相互转化public class TokenizerApp public static String encodeString routeStr String firstLetter = quotquotString resultStr。

quottokenizerquot quotik_max_wordquot,quotik_smart_synonymquot es 修改setting 打开APP weixin_07 关注 JAVA代码ES设置setting_Elasticsearches索引设置settings参数详解 原创 20210224 030019 weixin_07;HCT也是一个通用的中文分词工具HCT全称为HanLP Common Tokenizer,是由一套基础分词算法组成的通用中文分词工具高效采用Java8函数式编程风格实现,多核支持,秒级别性能精准中文分词采用bigram隐马模型,实体名词识别。

然后再匹配一次,又会提示Italy这就是Multi的由来支持多个单词的提示,当然必须设置正确的分词方式Tokenizer解决办法就是通过setThresh来设置至少输入几个字符后才会有提示 这样输入一个字符的时候就会开始提示。

相关文章

发表评论

评论列表

- 这篇文章还没有收到评论,赶紧来抢沙发吧~